王登宇论AIGC时代的数据处理与存储解决方案 构建高效、可靠的基础设施

随着生成式人工智能(AIGC)技术的爆发式发展,海量、多模态、高复杂度的数据已成为驱动模型训练与内容生成的核心燃料。在这一背景下,数据处理与存储不再仅仅是后台支持,而是直接关系到模型性能、创新效率与业务成败的关键基础设施。本文将探讨王登宇视角下,面向AIGC的数据处理与存储解决方案的核心挑战、技术架构及未来趋势。

核心挑战:AIGC数据的独特性

AIGC数据呈现出前所未有的特征,对传统数据处理与存储体系提出了严峻挑战:

- 数据规模海量且增长迅猛:高质量文本、图像、音频、视频等多模态训练数据集常达PB甚至EB级,且持续高速生成与迭代。

- 数据格式与结构高度复杂:除了原始媒体文件,还包括复杂的标注信息(如描述文本、边界框、语义分割图)、模型参数、中间训练状态、版本元数据等,关联关系复杂。

- 处理流程苛刻:训练过程需要极高的I/O吞吐量和低延迟的数据访问,对存储系统的并发性能和带宽是巨大考验。推理阶段则要求数据能够被快速检索和调用。

- 数据治理与合规要求高:涉及版权、隐私、伦理的数据清洗、脱敏、溯源与生命周期管理变得至关重要。

解决方案架构:分层协同与智能管理

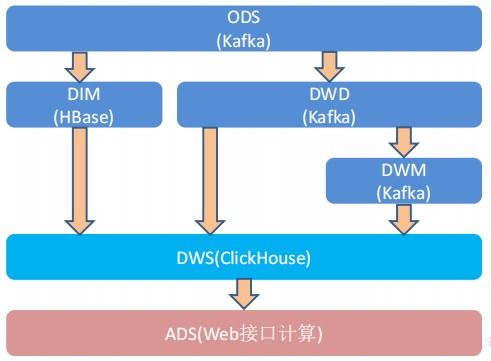

王登宇提出的解决方案强调构建一个弹性、高性能、智能化的分层数据处理与存储体系:

1. 高性能并行存储层:

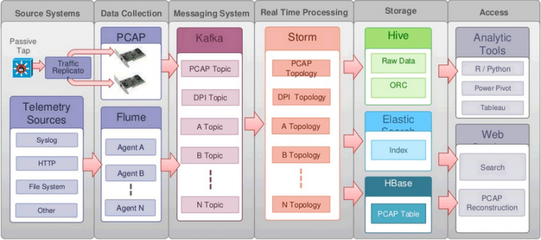

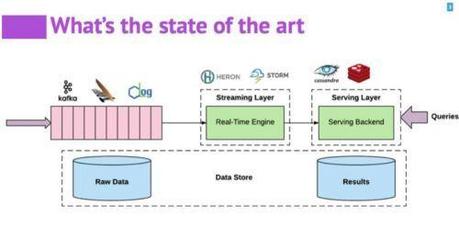

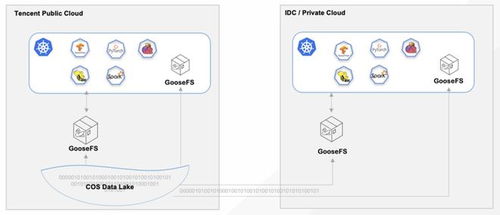

- 核心:采用分布式文件系统(如Ceph、Lustre)或对象存储(兼容S3协议),为海量非结构化数据提供可线性扩展的容量和吞吐量。

- 优化:针对训练场景,通过SSD缓存、内存缓存(Alluxio等)构建热数据加速层,大幅减少GPU等待数据的时间。

2. 智能数据湖与元数据管理:

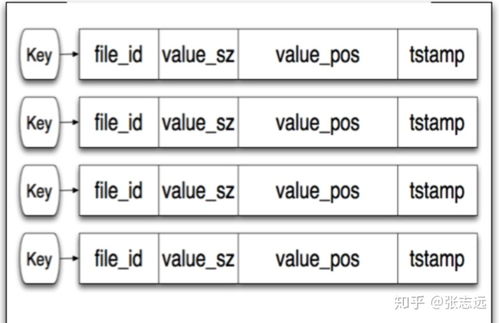

- 核心:构建以数据湖为核心的统一存储池,整合多源、多模态数据。关键在于强大的元数据管理,对数据来源、格式、版本、质量、使用记录等进行全链路追踪与编目。

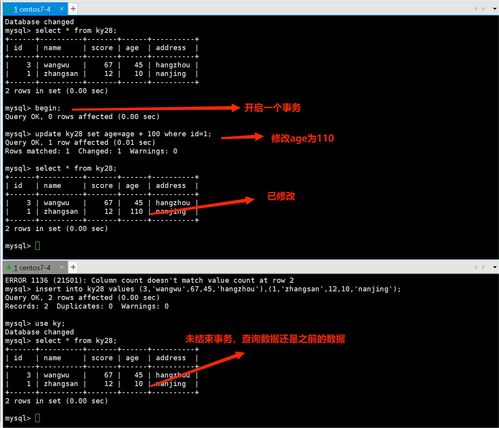

- 工具:结合Apache Iceberg、Delta Lake等表格格式,实现数据版本控制、ACID事务,确保训练实验的可复现性。

3. 高效数据处理流水线:

- 核心:实现从数据摄入、清洗、标注、增强到特征提取、格式转换的自动化流水线。利用Kubernetes等容器编排技术实现计算资源的弹性伸缩。

- 技术栈:广泛使用Spark、Ray、Dask等分布式计算框架,以及针对图像/视频的专用处理库,提升预处理效率。

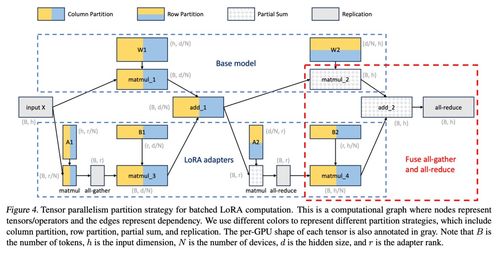

4. 模型与参数的专业存储:

- 核心:为模型检查点、微调参数、嵌入向量等设计专用存储方案。通常结合高性能本地NVMe存储(用于训练期频繁的检查点保存)与对象存储(用于长期归档与共享),并通过快照和版本控制保障安全。

5. 数据安全与治理层:

- 核心:贯穿始终。集成数据加密(静态/传输中)、细粒度访问控制、审计日志。利用自动化工具进行合规性扫描、敏感信息识别与脱敏,并制定清晰的数据保留与销毁策略。

未来趋势与王登宇的见解

王登宇认为,AIGC数据基础设施的演进将聚焦于:

- 存算一体与近数据计算:为了打破“数据搬运”的瓶颈,在存储节点或附近集成计算能力(如智能网卡、计算存储硬盘),直接在数据驻留地进行过滤、转换等初步处理。

- 向量数据库的深度融合:随着多模态大模型发展,向量数据库将成为存储和检索模型生成的嵌入向量的关键组件,与传统存储系统紧密集成,以支持高效的语义检索与个性化生成。

- AI赋能的自动化数据管理:利用AI来预测数据热度、自动优化数据布局、识别数据质量问题、生成数据标注建议,实现存储与处理系统的自优化。

- 绿色可持续性:面对巨大的能耗,方案将更注重通过数据压缩、去重、冷热分层等技术提升存储密度与能效。

###

在王登宇看来,面向AIGC的数据处理与存储解决方案,其核心目标是构建一个能够随AIGC业务弹性成长、最大化数据价值流动效率、同时保障安全与合规的智能数据基座。这不再是一个单纯的IT项目,而是需要与算法研发、业务场景深度协同的战略性工程。成功的解决方案必然是软件定义、硬件加速、云原生架构与智能化运维的有机结合,为AIGC的创新与落地提供坚实、澎湃的数据动力。

最新产品